Como aquilo que você vê pode influenciar o que você ouve

Autores

Christian J. Summer, Paula C. Stacey

Jovens revisores

Resumo

Para entender o mundo à nossa volta, utilizamos, de forma automática, mais de um dos nossos sentidos. Quando conversamos, quase sempre usamos os ouvidos para escutar o que as outras pessoas estão dizendo. Mas você pode ficar surpreso ao saber que o que vê é também muito importante para ajudá-lo a entender os outros. Este artigo analisa o modo pelo qual a audição e a visão se combinam, e explica por que esses dois sentidos nos ajudam a compreender a fala. Mostramos como é importante ver os rostos das pessoas que estão conversando, em particular em lugares barulhentos. Esse tópico possui implicações importantes no caso do uso de máscaras! Vale mesmo a pena refletir sobre como as máscaras podem afetar a capacidade das pessoas para se comunicarem.

Introdução

Você já teve dificuldades para entender o que seus amigos e professores dizem quando usam máscaras? Por que isso acontece? Quase todo mundo se beneficia da possibilidade de enxergar o rosto de uma pessoa enquanto conversa com ela. Os vários sons que ela emite ao falar exigem que mova sua boca de determinadas formas e, mesmo que você não se dê conta, seu cérebro compreende esses formatos específicos da boca! Os formatos tornam mais fácil para nós entendermos as pessoas quando podemos vê-las conversando.

O cérebro possui áreas especializadas que processam a informação vinda dos sentidos e nos permite compreender o mundo. Algumas dessas áreas combinam automaticamente a informação oriunda de vários sentidos. Quando a informação proveniente de um sentido (a audição, por exemplo) não é confiável, passamos de imediato a confiar mais naquela que veio de outro (como a visão). Por isso, você logo percebe os benefícios de ver as pessoas conversando quando está em um lugar barulhento.

Neste artigo, começaremos por mostrar as diferenças entre sensação e percepção, e usaremos uma ilusão de ótica bem conhecida para provar que a percepção às vezes pode ser imprecisa. Isso o ajudará a entender que a coisa percebida não corresponde necessariamente à informação que está no mundo. Em seguida, explicaremos o modo como nossos cérebros combinam as informações de diferentes sentidos, em particular a visão e a audição.

Dando sentido ao mundo

Seus ouvidos captam as ondas sonoras e você as ouve como som. Seus olhos captam a energia luminosa, o que lhe proporciona a visão. Chamamos esses processos de sensação. O que seu cérebro faz com a informação vinda dos sentidos é chamado de percepção. Na maioria das vezes, achamos que o que sentimos e o que percebemos são a mesma coisa. Mas pode acontecer que nossos cérebros cheguem a conclusões erradas sobre o que existe por aí! A percepção pode ser complicada: exige combinar o que nossos sentidos nos dizem com o que já sabemos sobre o mundo, para fazer a melhor suposição possível sobre o que está acontecendo. Podemos entender mal ou interpretar erroneamente as sensações, percebendo então algo que simplesmente não é verdade.

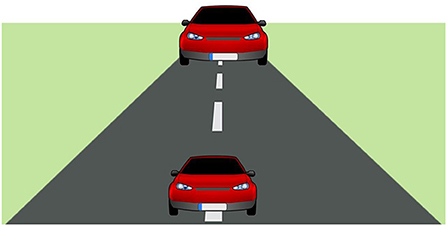

As ilusões de ótica são fascinantes de se observar e nos dão um bom exemplo de como, às vezes, o cérebro interpreta mal as sensações e nos dá uma percepção errada. Dê uma olhada na Figura 1. Qual dos dois carros é o maior? Agora pegue uma régua e meça-os. Você acertou?

À primeira vista, você pode pensar que o carro de cima é maior que o de baixo, mas na verdade eles são do mesmo tamanho! Chamamos isso de ilusão de ótica porque a imagem engana seu cérebro fazendo-o pensar que os carros são de tamanhos diferentes. Isso acontece porque as informações da imagem (por exemplo, o formato da estrada) fazem com que o carro de cima pareça estar mais distante que o carro de baixo. Normalmente, as coisas que estão longe parecem menores que as que estão perto de nós (da próxima vez que você viajar de carro, observe o tamanho dos veículos distantes em comparação com os que estão perto), de modo que o carro de cima deveria parecer menor porque está mais distante. O cérebro de alguma forma sabe disso, então “aumenta” automaticamente a percepção do tamanho do carro. Na vida real, esse ajuste mental geralmente funciona bem e ajuda nossa percepção do mundo a fazer sentido.

Combinação de sentidos

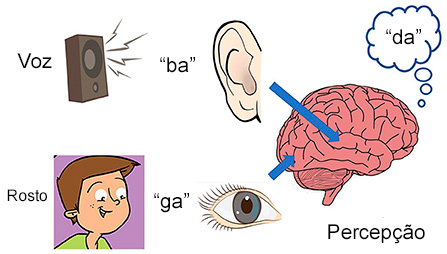

Sabemos que nosso cérebro muitas vezes usa a visão e a audição a fim de entender o mundo. Assim, fica mais fácil para ele determinar, de forma correta, o que está acontecendo, do que seria se empregasse apenas um sentido. Mas, assim como uma ilusão de ótica pode pregar peças ao cérebro através dos olhos, uma ilusão audiovisual pode confundir a percepção se as informações provenientes da audição e da visão não apresentarem correspondência. Isso foi ilustrado por um experimento realizado por Harry McGurk e John McDonald em 1976 [1]. Esses cientistas gravaram uma pessoa proferindo o som “ba”. Em seguida, fizeram um vídeo silencioso da mesma pessoa proferindo o som “ga”. Reproduziram o som (“ba”) junto com o vídeo (“ga”) e pediram aos voluntários que dissessem qual som ouviram. Você pode ficar surpreso ao saber que a maioria dos voluntários disse ter ouvido o som “da”! Isso ocorreu porque seus cérebros misturaram o que viram e ouviram, e deram um palpite sobre qual era realmente o som.

O mais surpreendente sobre esse experimento (chamado de efeito McGurk, ver Figura 2) é que ele muda mesmo a forma como as palavras soam. O experimento mostrou que ver um rosto falando pode exercer um efeito poderoso nos sons que as pessoas percebem1. O efeito também é encontrado em outras combinações de sons. A percepção da fala é, na verdade, o resultado do cérebro fazendo as melhores suposições possíveis sobre o que vemos, o que ouvimos e o que já sabemos sobre a linguagem.

Como a visão nos ajuda a ouvir em lugares barulhentos

No mundo real, os movimentos dos lábios quase sempre correspondem aos sons que saem da boca das pessoas; portanto, em geral ver alguém falar nos ajuda a perceber a palavra certa. Essa informação visual tende a ser mais útil para a compreensão da fala quando a conversa ocorre em um ambiente barulhento. Experimente sentar-se em uma sala silenciosa com um amigo. Você provavelmente achará muito fácil entender o que ele disser. Em seguida, ligue a televisão com o volume bem alto. Até que ponto agora é fácil entender seu amigo? Fica muito mais difícil ouvir e entender o que alguém está dizendo se o fundo for muito barulhento. Se você olhar para o rosto e os lábios de seu amigo, é mais provável que adivinhe corretamente o que ele estiver dizendo.

Como medir a influência da visão sobre o entendimento da fala

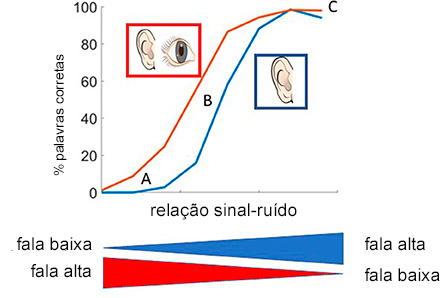

Realizamos alguns experimentos sobre como o ruído de fundo afeta a compreensão de uma frase [2]. Primeiro, filmamos e gravamos um voluntário dizendo diversas frases diferentes (como “É difícil vender sapatos de tamanho grande”). Depois, reproduzimos essas gravações para outros voluntários, pedimos que repetissem o que ouviram e contamos quantas palavras acertaram. Repetimos essa experiência com muitos voluntários, adicionando vários níveis de ruído de fundo ou reduzindo o volume do sinal de fala. A relação entre o sinal de fala e o ruído de fundo é chamada de relação sinal-ruído. Às vezes, reproduzíamos apenas o som da pessoa que falava; outras, mostrávamos também seu vídeo, para que os voluntários pudessem vê-la e ouvi-la falando.

Colocamos as informações recolhidas em um gráfico (Figura 3). Quando o ruído de fundo era muito mais alto que a voz da pessoa, nossos voluntários não conseguiam identificar nenhuma palavra corretamente. Mas quando as frases eram mais altas que o ruído de fundo, nossos voluntários acertavam a maioria das palavras. Entre essas duas situações, os voluntários podiam identificar corretamente algumas palavras, mas não todas. Nossos resultados mostram claramente que as pessoas podem compreender a fala com mais ruído de fundo presente se puderem ver os rostos dos locutores. Esse efeito explica por que você pensa ouvir melhor quando vê as pessoas falando, especialmente quando está em um local barulhento. Estudos anteriores obtiveram resultados similares [3].

Por que isso é importante? Imagine-se trabalhando em uma fábrica barulhenta, com máquinas perigosas e estridentes, e seu colega de trabalho tentando explicar exatamente como usar uma delas. Com todo esse barulho no fundo, você acha que seria capaz de ouvir as instruções claramente? E se seu colega de trabalho estiver usando uma máscara de segurança enquanto conversa? Nesse tipo de ambiente, cometer um erro pode ser muito perigoso e até resultar em lesões.

Os benefícios da informação visual para pessoas com perda auditiva

Você já tentou entender o que alguém está dizendo apenas olhando para o rosto dele, sem ouvir as palavras? Pois saiba que, quanto pior for sua audição, melhor se sairá nessa tarefa. Pessoas surdas ou com deficiência auditiva são geralmente melhores na leitura labial do que pessoas com audição normal [4]. Essa habilidade, provavelmente, se desenvolveu ao longo do tempo, à medida que elas foram perdendo a audição e tiveram que recorrer mais aos outros sentidos.

Durante o surto de coronavírus, o uso de máscaras faciais costumava ser obrigatório. As máscaras dificultam muito a leitura labial para as pessoas que precisam fazê-la. No Reino Unido, ativistas conseguiram persuadir o governo a fornecer máscaras faciais transparentes para ajudar as pessoas surdas a se comunicarem. Em nossa pesquisa, procuramos entender até que ponto a leitura labial facilita a comunicação e, principalmente, como auxilia pessoas com problemas auditivos.

Conclusão

A informação visual é muito importante para nos ajudar a entender os sons que ouvimos. O que vemos é especialmente importante para a compreensão da fala quando o som que ouvimos é afetado pelo ruído de fundo ou pela deficiência auditiva. Ainda há muita coisa que não entendemos sobre como o cérebro combina o que vemos e o que ouvimos. Da próxima vez que você estiver em um ambiente barulhento, procure notar como é importante ver os rostos das pessoas que estão falando e pense no que poderia ser feito para tornar as informações visuais da fala mais acessíveis a pessoas com problemas auditivos.

Glossário

Sensação: Processo pelo qual nossos sentidos coletam informações do mundo.

Percepção: Processo pelo qual nossos cérebros dão sentido à informação fornecida pelos sentidos.

Efeito McGurk: Ilusão audiovisual que ocorre quando ouvimos um som (por exemplo, “ba”) enquanto observamos os movimentos da boca que acompanham outro som (por exemplo, “ga”), daí resultando a percepção de um novo som (por exemplo, “da”).

Relação sinal-ruído: Medida da força do “sinal” (em nosso caso, fala) contra o ruído de fundo.

Leitura labial: Compreensão da fala apenas a partir dos movimentos da boca.

Nota de rodapé

[1] Veja este vídeo para uma demonstração do efeito: https://www.youtube.com/watch?

v=jtsfidRq2tw&t=20s

Referências

[1] McGurk, H. e MacDonald, J. 1976. “Hearing lips and seeing voices.” Nature 264:746–8.

[2] Stacey, P. C., Kitterick, P. T., Morris, S. D. e Summer, C. J. 2016. “The contribution of visual information to the perception of speech in noise with and without informative temporal fine structure.” Hear. Res. 336:17–28. DOI: 10.1016/j.heares.2016.04.002.

[3] Sumby, W. H. e Pollack, I. 1954. “Visual contribution to speech intelligibility in noise.” J. Acoust. Soc. Am. 26:212–5.

[4] Schreitmüller, S., Frenken, M., Bentz, L., Ortmann, M., Walger, M. e Meister, H. 2018. “Validating a method to assess lipreading, audiovisual gain, and integration during speech reception with cochlear-implanted and normal-hearing subjects using a talking head.” Ear Hear. 39:503–16. DOI: 10.1097/AUD. 0000000000000502.

Citação

Stacey, P. C. e Summer, C. J. (2022) “How what you see can influence what you hear.” Front. Young Minds. 10:705956. DOI: 10.3389/frym.2022.705956.

Este é um artigo de acesso aberto distribuído sob os termos da Creative Commons Attribution License (CC BY). O uso, distribuição ou reprodução em outros fóruns é permitido, desde que o(s) autor(es) original(is) e o(s) proprietário(s) dos direitos autorais sejam creditados e que a publicação original nesta revista seja citada, de acordo com a prática acadêmica aceita. Não é permitido nenhum uso, distribuição ou reprodução que não esteja em conformidade com estes termos.

Encontrou alguma informação errada neste texto?

Entre em contato conosco pelo e-mail:

parajovens@unesp.br